반응형

Index

Up-Sampling

- 앞서 convolution - maxpooling 과정은 dimension reduction 즉 down-sampling 이라고 했다.

- Up-sampling (≒Decoing)은 Down-sampling (≒Encoding) 의 반대방향 변환이다.

- CNN 관점에서 Up-sampling은 압축된 low resolution feature map으로 high resolution image를 generate하는 것이다.

- UP-sampling의 대표적인 non-learnable한 방식이 interpolation(보간) 기법이다.

- 반면, 대표적인 Convolution을 이용한 learnable 방법이 ①Transpose convolution ②Fractionally-strided-convolution

- Transposed Convolution : convolution 과 반대로 one-to-many relation 방향이고, positional connectivity (왼쪽위에 있는 값은 왼쪽위로..)를 유지한다. Conv layer에서 convolution matrix를 사용한 것과 같이, Transposed Convolution matrix를 사용하고, 이는 conv matrix를 transpose한 것과 모형만 같고 원소는 다르다.

- Fractionally-strided-convolution : zero-padding을 가장자리에 하는것이 아닌 input pixel의 사이공간에 padding하는 방식이다. 즉 1/n striding의 의미는 input 사이에 n-1개씩 padding한다는 것이다.

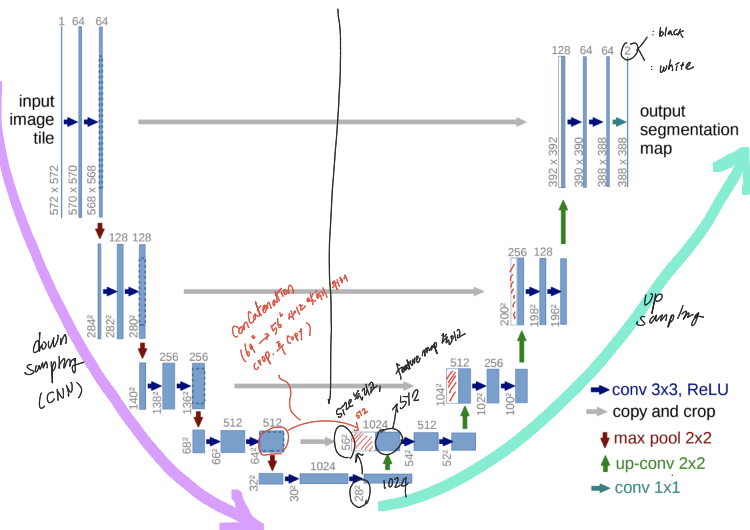

U-Net

- Object segmentation을 위한 CNN 구조이다.

- Context를 포착하기 위한 Contraction path (Down-sampling)과, Localization을 위한 Expanding path (Up-sampling)으로 구성되어있다. Context는 각각의 피쳐가 이미지에서 의미하는게 무엇인지 포착하는 것, Localization은 포착된 피쳐의 위치정보와 boundary를 찾는것이다.

- Expanding의 과정에서는 Contraction에서 최종 추출된 feature만으로는 local정보를 만들어내기 어렵기 때문에, Contracting path의 higher resolution featuremap 들이 crop© 방식으로 concatenate 된다.

반응형

'Study > DL' 카테고리의 다른 글

| RNN - 2편 (LSTM) (0) | 2023.07.01 |

|---|---|

| RNN - 1편 (RNN구조, RNN의 Backpropagation) (0) | 2023.07.01 |

| CNN - 2편 (Bottleneck, ResNet,Dropout) (0) | 2023.06.29 |

| CNN - 1편 (CNN의 구조) (0) | 2023.06.29 |

| Dropout 과 Batch Normalization (0) | 2023.06.29 |

댓글